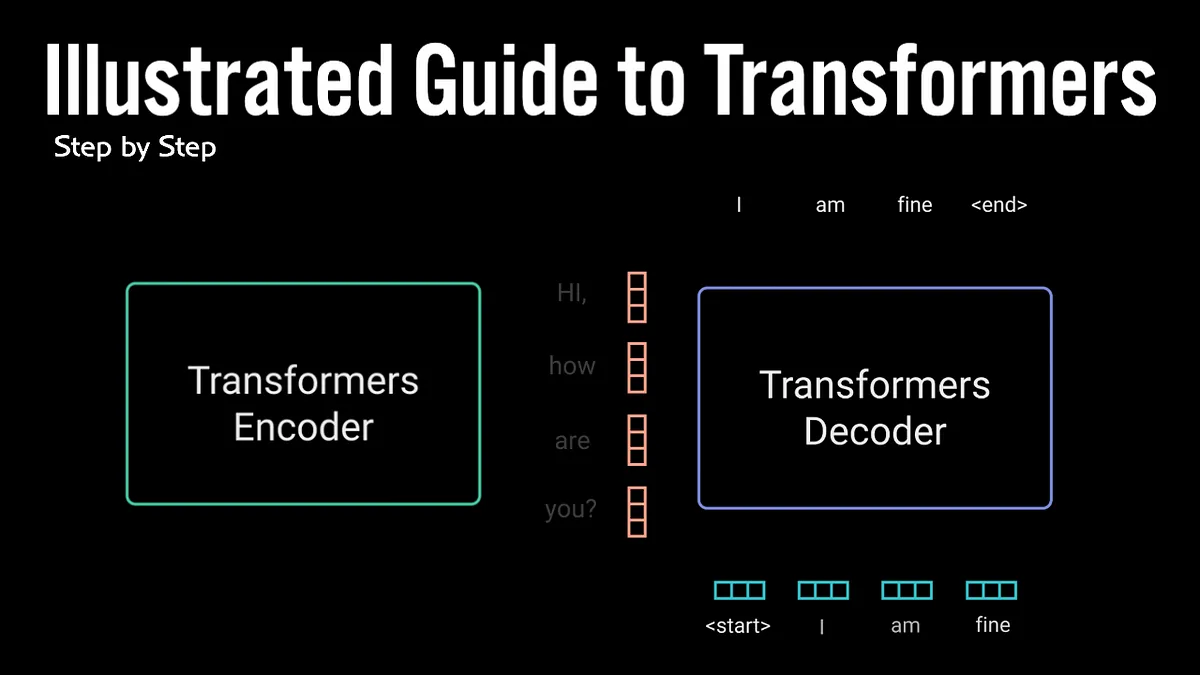

Minh họa Transformer

Minh họa Transformer là bản dịch tiếng Việt của The Illustrated Transformer, Bản gốc được viết bởi Jay Alammar ( @JayAlammar ), hiện được sử dụng tại các lớp học tại MIT. Bản dịch được sửa đổi một phần không đáng kể để phù hợp hơn với bạn đọc. Transformer được đề xuất trong paper Attention is All You Need. … Đọc tiếp