AI đang ở khắp nơi. Mở báo thấy AI. Lướt mạng thấy AI. Xem hội thảo, đọc quảng cáo tuyển dụng, đâu cũng có AI. Chỉ trong vài năm, trí tuệ nhân tạo đã từ một khái niệm kỹ thuật trở thành chủ đề thời sự toàn cầu.

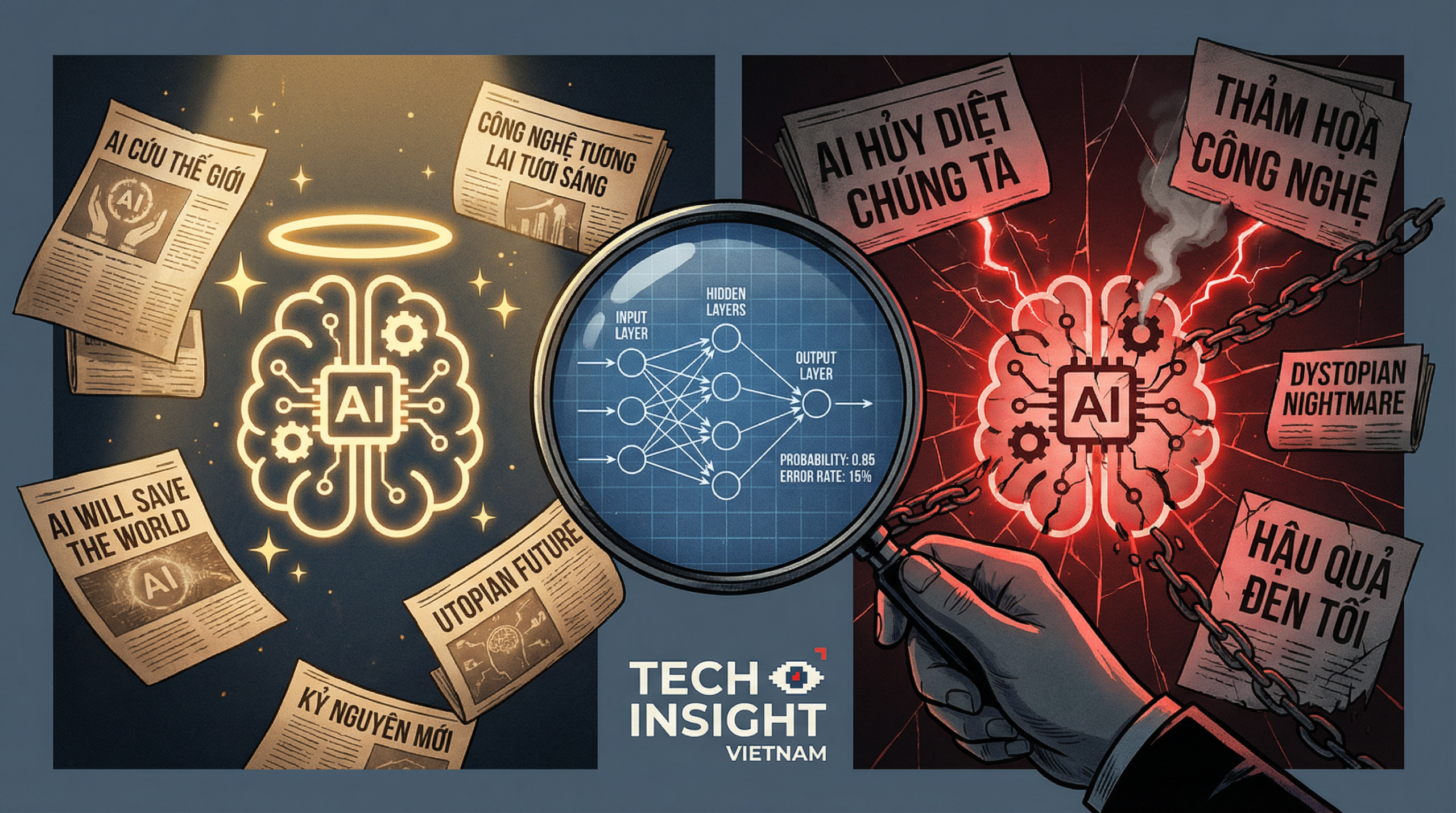

Nhưng giữa cơn sóng đó, một câu hỏi cần được đặt ra: truyền thông AI hiện đại đang làm rõ vấn đề, hay đang làm mọi thứ rối hơn?

Câu trả lời khá rõ: phần lớn đang làm rối hơn.

Vấn đề không nằm ở chỗ AI không quan trọng. Ngược lại, AI rất quan trọng. Vấn đề nằm ở cách nó đang được kể cho công chúng: quá cảm tính, quá cực đoan, quá thích gây sốc, và quá ít trung thực về giới hạn thật sự.

AI đang bị biến thành một câu chuyện để bán attention

Nói thẳng ra, nhiều nội dung về AI hiện nay không được xây dựng để giúp người đọc hiểu đúng. Nó được xây dựng để giành lấy sự chú ý.

Có nơi mô tả AI như vị cứu tinh sắp thay đổi toàn bộ thế giới. Có nơi lại nói như thể ngày máy móc thống trị loài người đã ở trước mắt. Hai thái cực này đều có điểm chung: dễ viral.

Khi attention trở thành mục tiêu, nội dung sẽ tự động bị kéo về phía giật gân. Càng cực đoan, càng dễ lan. Càng đơn giản hóa quá mức, càng dễ chia sẻ. Và AI là mảnh đất rất màu mỡ cho kiểu truyền thông đó, vì đa số công chúng chưa hiểu rõ bản chất kỹ thuật của nó.

Truyền thông AI đang thổi phồng nhiều hơn là giải thích

Nhiều tiêu đề kiểu như:

- AI thay thế lập trình viên

- AI sắp cướp hết việc làm văn phòng

- AI có thể suy nghĩ như con người

- AI vượt mặt con người trong mọi lĩnh vực

Nghe rất mạnh. Nhưng khi bóc tách kỹ, phần lớn các tuyên bố này đều thiếu điều kiện đi kèm.

Một mô hình có thể viết code trong vài tình huống không có nghĩa là nó thay được một kỹ sư phần mềm ngoài đời thật. Một chatbot trả lời mượt trong demo không có nghĩa là nó đáng tin khi xử lý hồ sơ pháp lý, y tế hay tài chính. Một video trình diễn đẹp không có nghĩa là công nghệ đó đã sẵn sàng để vận hành ở quy mô lớn.

Truyền thông thường bỏ qua phần khó nhất: từ demo đến triển khai thực tế là cả một khoảng cách rất xa.

Người ta đang nhầm giữa “AI làm được” và “AI dùng được”

Đây là một điểm rất quan trọng nhưng thường bị bỏ quên.

Trong thế giới công nghệ, có một khác biệt lớn giữa:

- làm được trong phòng lab

- demo được trên sân khấu

- chạy được trong môi trường thật

- vận hành ổn định với chi phí hợp lý

Nhiều bài báo, video và bài đăng mạng xã hội đang trộn lẫn hai thứ này. Một công cụ AI có thể làm ra một bức ảnh đẹp, một đoạn văn hay, một bản tóm tắt mượt. Nhưng câu hỏi thật sự cần hỏi là: nó có hoạt động ổn định mỗi ngày không, có gây lỗi nghiêm trọng không, ai chịu trách nhiệm khi nó sai, và chi phí để dùng nó lâu dài là bao nhiêu?

Không trả lời được các câu hỏi đó thì nói “AI đã thay đổi cuộc chơi” vẫn còn quá sớm.

Truyền thông đang nhân cách hóa AI quá mức

Đây là lỗi rất dễ lan truyền vì nó hợp với cách con người tiếp nhận câu chuyện.

Chúng ta liên tục thấy những cách diễn đạt như:

- AI hiểu bạn

- AI biết suy nghĩ

- AI muốn làm điều này

- AI đang học như con người

- AI sợ bị tắt

Về mặt truyền thông, cách nói này rất tiện. Nó giúp câu chuyện hấp dẫn hơn, dễ nhớ hơn, dễ gây tranh luận hơn. Nhưng về mặt nhận thức, nó làm lệch bản chất.

Phần lớn hệ thống AI hiện nay không “hiểu” theo nghĩa con người hiểu. Nó không có ý thức, không có mong muốn, không có cảm xúc, không có mục tiêu nội sinh như cách con người có. Nó chủ yếu là hệ thống dự đoán xác suất cực lớn, được tối ưu để tạo ra đầu ra có vẻ hợp lý từ dữ liệu đã học.

Khi AI bị mô tả như một sinh vật biết nghĩ, công chúng sẽ rất dễ rơi vào hai phản ứng sai: hoặc thần thánh hóa, hoặc hoảng loạn hóa.

Người ta khoe thành công, nhưng giấu rất kỹ các kiểu lỗi

Một lý do khiến truyền thông AI dễ gây hiểu lầm là vì nó thường chỉ cho công chúng thấy phần đẹp nhất của hệ thống.

Người xem được thấy:

- ảnh tạo ra cực ấn tượng

- chatbot trả lời mượt

- video demo trơn tru

- số benchmark rất cao

Nhưng ít khi được thấy:

- AI bịa thông tin

- AI trả lời rất tự tin dù sai hoàn toàn

- AI nhạy cảm quá mức với cách đặt câu hỏi

- AI xử lý kém ở dữ liệu hiếm hoặc bẩn

- AI có thể rò rỉ thông tin

- AI dễ tạo ra đầu ra thiếu nhất quán

Vấn đề nguy hiểm nhất không phải là AI quá thông minh. Vấn đề nguy hiểm hơn là người dùng tin sai mức độ đáng tin của AI.

Một hệ thống đôi khi đúng, đôi khi sai, nhưng luôn trả lời rất tự tin, là kiểu hệ thống cực dễ bị dùng sai trong môi trường thật.

Điểm benchmark đang bị dùng như khẩu hiệu marketing

Nhiều công ty và nhiều bài báo rất thích đưa ra các điểm số ấn tượng để chứng minh AI đang tiến bộ vượt bậc. Điều đó không sai hoàn toàn. Benchmark có giá trị. Nhưng benchmark không phải sự thật trọn vẹn.

Một mô hình đạt điểm rất cao trong bài test chuẩn không đồng nghĩa với việc:

- nó làm tốt trong doanh nghiệp thật

- nó đáng tin khi người dùng nhập dữ liệu lộn xộn

- nó giữ ổn định qua thời gian

- nó tiết kiệm chi phí

- nó dễ tích hợp vào quy trình cũ

Công chúng thường không có thời gian để phân biệt đâu là thành tích trong lab, đâu là hiệu quả thật ngoài đời. Vì vậy, mỗi khi thấy các con số rất đẹp, người đọc thường vô thức nghĩ rằng “công nghệ này chắc đã rất hoàn thiện”. Trong nhiều trường hợp, đó là kết luận quá sớm.

Truyền thông AI đang chia thế giới thành hai cực sai lệch

Một bên nói AI sẽ cứu kinh tế, cứu giáo dục, cứu y tế, cứu năng suất lao động và mở ra thời đại vàng mới. Bên còn lại nói AI sẽ cướp việc, phá xã hội, giết sáng tạo, thao túng con người và đẩy loài người vào khủng hoảng.

Sự thật thường không nằm ở hai đầu đó.

AI không phải phép màu toàn năng. Nhưng nó cũng không phải trò lừa đảo hoàn toàn. Nó là một công cụ nền tảng mạnh, có tác động rất lớn ở một số ngành, tác động vừa phải ở nhiều ngành khác, và gần như không đáng kể ở một số lĩnh vực nhất định trong ngắn hạn.

Lợi ích kinh tế đang bẻ cong cách AI được kể

Rất nhiều bên đang có lý do để kể về AI theo cách có lợi cho họ:

- công ty công nghệ cần hút vốn, hút khách hàng, hút niềm tin thị trường

- startup cần một narrative đủ lớn để gọi vốn

- quỹ đầu tư cần đẩy kỳ vọng

- báo chí cần traffic

- KOL cần lượt xem

- người bán khóa học cần FOMO

- các nền tảng cần giữ người dùng ở lại lâu hơn

Khi động cơ là kiếm tiền, giành thị phần hoặc xây vị thế, thông tin trung tính sẽ thường thua thông tin gây kích thích.

Vì vậy, nếu đọc một bài viết về AI mà không tự hỏi “ai được lợi nếu tôi tin điều này”, thì gần như chắc chắn là đang đọc một nửa câu chuyện.

Một chữ “AI” nhưng đang nói về quá nhiều thứ khác nhau

Đây là lỗi làm hỏng rất nhiều cuộc tranh luận.

Nhiều người nói “AI” nhưng không nói rõ họ đang nói về cái gì:

- mô hình ngôn ngữ lớn

- công cụ tạo ảnh

- AI trong doanh nghiệp

- robot vật lý

- hệ thống gợi ý

- tự động hóa quy trình

- tác động việc làm

- pháp lý và quản trị

- chip, hạ tầng, dữ liệu

Một từ “AI” đang bị dùng để chỉ quá nhiều lớp khác nhau. Hệ quả là tranh luận thường đi vào mơ hồ. Mỗi người nghĩ về một thứ, nhưng lại tưởng đang nói cùng một chuyện.

Muốn nói đúng về AI, ít nhất phải tách được mấy lớp sau:

- model layer: tầng mô hình

- application layer: tầng ứng dụng

- data layer: tầng dữ liệu

- infrastructure layer: tầng hạ tầng

- business process layer: tầng quy trình kinh doanh

- policy layer: tầng chính sách và pháp lý

Không tách lớp, tranh luận sẽ luôn ồn ào nhưng ít giá trị.

Điều công chúng cần không phải thêm drama, mà là thêm độ chính xác

AI là công nghệ có ảnh hưởng thật. Vì vậy, thứ cần nhất lúc này không phải là thêm những tiêu đề gây sốc. Thứ cần nhất là độ chính xác trong cách giải thích.

Công chúng cần biết:

- AI giỏi ở đâu

- AI dở ở đâu

- AI đang được dùng thật ở đâu

- AI đang bị thổi phồng ở đâu

- rủi ro thực tế là gì

- giới hạn kỹ thuật là gì

- ngành nào sẽ thay đổi nhanh

- ngành nào sẽ thay đổi chậm

- khi nào nên dùng AI

- khi nào không nên tin AI

Một nền truyền thông lành mạnh không có nhiệm vụ làm công nghệ trông kỳ bí hơn. Nó có nhiệm vụ làm công nghệ trở nên dễ hiểu hơn.

Vậy nên nhìn truyền thông AI thế nào cho đúng?

Có một cách rất đơn giản để tự vệ trước làn sóng thông tin AI hiện nay. Mỗi khi gặp một tuyên bố lớn về AI, nên tự hỏi 5 câu sau:

1. Đây là demo hay là triển khai thực tế?

Nếu chỉ là video trình diễn, giá trị thực tế vẫn chưa được chứng minh.

2. Tỷ lệ lỗi là bao nhiêu?

Một công nghệ không thể chỉ được đánh giá bằng lúc nó đúng. Phải đánh giá cả lúc nó sai.

3. Nó hoạt động tốt trong điều kiện nào?

Cần biết rõ phạm vi áp dụng, không thể suy diễn từ vài ví dụ đẹp.

4. Chi phí vận hành và giám sát là gì?

Rất nhiều giải pháp AI nhìn rẻ ở bề mặt nhưng đắt ở khâu triển khai, kiểm tra, giám sát và sửa lỗi.

5. Ai được lợi khi thông điệp này được tin?

Câu hỏi này giúp bóc tách động cơ đằng sau mọi narrative.

Kết luận

Vấn đề lớn nhất của truyền thông AI hiện đại không phải là nó nói về AI quá nhiều. Vấn đề là nó đang nói về AI theo cách làm méo nhận thức của công chúng.

Một hệ thống xác suất với rất nhiều giới hạn, trade-off và rủi ro đang bị kể thành câu chuyện phép màu. Một công nghệ còn đầy điểm yếu đang bị đóng gói thành định mệnh lịch sử. Một lĩnh vực cần sự tỉnh táo lại đang bị chi phối bởi cảm xúc, FOMO và các cuộc đua attention.

AI là chủ đề quá quan trọng để bị kể theo kiểu đơn giản hóa rẻ tiền.

Muốn hiểu đúng AI, cần bớt tin vào tiêu đề, bớt bị kéo bởi cảm xúc, và nhìn mọi tuyên bố bằng logic, bằng dữ liệu, và bằng câu hỏi rất cơ bản: thực tế vận hành là gì?

Khi truyền thông thôi bán giấc mơ và bắt đầu tôn trọng sự thật, lúc đó công chúng mới có cơ hội hiểu đúng về AI.

Hãy theo dõi trituenhantao.io để có những phân tích chuyên sâu và không bị lừa bởi truyền thông.